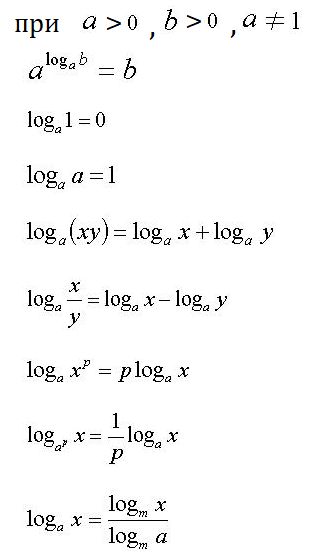

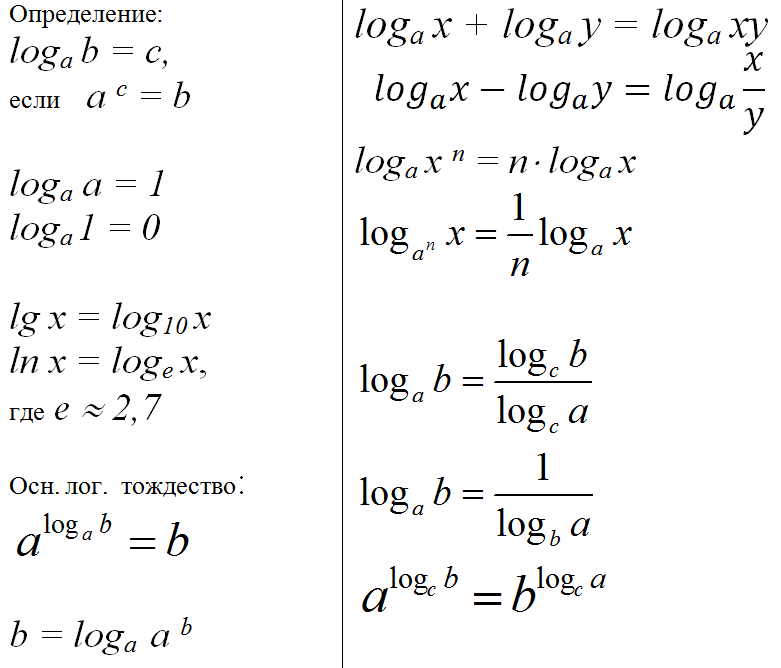

Все формулы связанные с логарифмами - Логарифм Википедия

Эксперимент 15. Комнатный термометр

В этом эксперименте мы измеряем температуру окружающей устройство среды и с помощью шкалы показываем, на сколько она превышает заданный порог. Вики Видео Вопросы Блог. Содержание Эксперимент Комнатный термометр. Задания для самостоятельного решения.

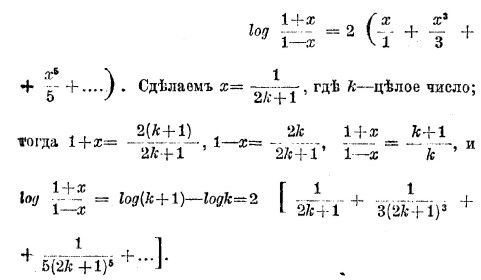

![Эксперимент Комнатный термометр [Амперка / Вики] Логарифмы степени числа — свойства с примерами, как решать задачи](https://upload.wikimedia.org/wikipedia/commons/thumb/4/4a/Log_(2).svg/290px-Log_(2).svg.png)

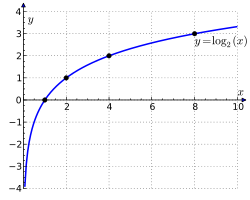

![Глава 4 Логарифмы и простые числа. Простые числа [Долгая дорога к бесконечности] Вы точно человек?](https://cf.ppt-online.org/files/slide/c/cs3BzWOy80PUJ7VKEvomlM5e6DF1YAfTjqtGha/slide-1.jpg)

Сплей-дерево англ. Splay-tree — это двоичное дерево поиска. Оно позволяет находить быстрее те данные, которые использовались недавно. Относится к разряду сливаемых деревьев.

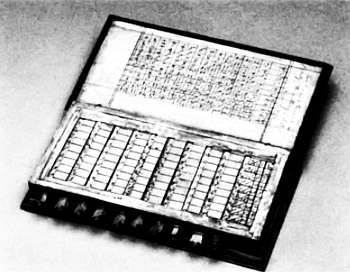

![Метод рационализации [pro-spektr.ru] Мотивация и определение](https://imgv2-1-f.scribdassets.com/img/document/621333072/149x198/266ad64d98/1674453995?v=1)

В теории информации энтропия — это средняя скорость генерирования значений некоторым случайным источником данных. Величина информационной энтропии, связанная с определенным значением данных, вычисляется по формуле:. Когда источник данных генерирует значение, имеющее низкую вероятность то есть когда происходит маловероятное, неожиданное событие , с ним связана большая информация, чем с более вероятным событием. Количество информации, выражаемое событием, связанным с появлением определенного значения данных, можно рассматривать как случайную переменную, математические ожидание которой и равно информационной энтропии. Таким образом, информационную энтропию можно рассматривать как меру неупорядоченности или неопределенности состояния некоторой системы, описываемой данными. В этом смысле она является прямым аналогом понятия энтропии, используемой в статистической термодинамике.

Похожие статьи

- Укладка каре с челкой - Укладки для каре и оригинальные варианты причесок на все случаи жизни

- Броши канзаши все мастер классы видео - Домашняя волшебница - Видео - уроки канзаши

- Работа со связанными объектами - Работа со связанными объектами Документация Django 1

- Видео и схема шали связанной крючком - Начинаем вязать Видео уроки вязания